IA avança na saúde, mas uso indiscriminado ainda traz riscos

Apesar de ampliar o acesso à informação e auxiliar em diagnósticos, modelos de linguagem acendem alerta sobre segurança e a qualidade das decisões em saúde

compartilhe

SIGA

Por Marília Marasciulo - O Conselho Federal de Medicina (CFM) publicou, no último dia 27 de fevereiro, uma resolução que regulamenta o uso da inteligência artificial (IA) na prática médica no Brasil. A norma estabelece que a decisão diagnóstica, terapêutica e prognóstica deve permanecer sob responsabilidade do médico, responsável por supervisionar o uso dessas ferramentas e informar o paciente quando elas forem utilizadas como apoio relevante.

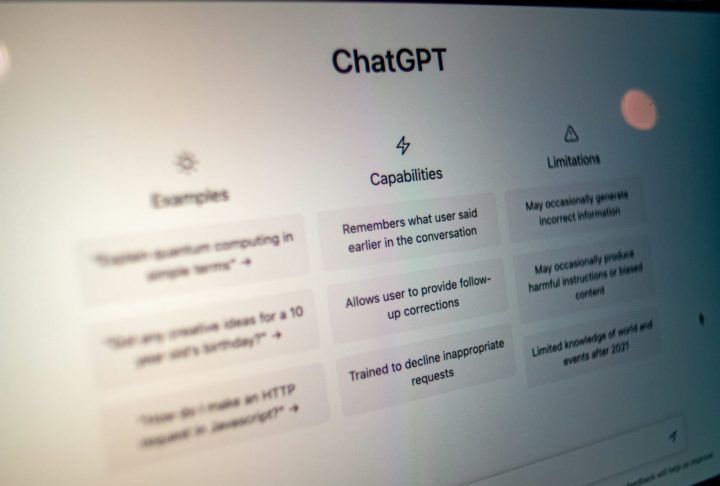

A medida ocorre em meio à rápida expansão de sistemas conversacionais voltados ao público. Em janeiro, o ChatGPT, sistema de IA generativa da empresa estadunidense OpenAI, ganhou uma funcionalidade exclusiva para a saúde: o GPT Health. A ferramenta foi desenhada para apoiar o usuário na compreensão de exames, no preparo para consultas e no acompanhamento de cuidados. Segundo a empresa, trata-se de um recurso exclusivamente informacional, com salvaguardas de privacidade e sem uso dos dados para treinamento de modelos.

As novidades formalizam uma tendência já em curso. De acordo com a própria OpenAI, mais de 230 milhões de pessoas fazem perguntas sobre saúde e bem-estar no ChatGPT toda semana. No Brasil, um estudo da Fundação Oswaldo Cruz (Fiocruz) de 2025 com 200 pacientes e 92 médicos identificou que 85,6% das pessoas pesquisaram informações de saúde na internet.

Mas, se por um lado essa prática ajuda o paciente a ter acesso a mais informações, por outro, pode gerar medo e preocupação desnecessários, além de impactar o atendimento. “Os pacientes já chegam no consultório com a informação que muitas vezes é obtida de uma IA. Então, o médico tem que conhecer isso para orientá-los melhor”, afirma o médico Edson Amaro, superintendente de Dados Globais e Tecnologias Avançadas para Equidade do Einstein Hospital Israelita.

A tecnologia já permeia todo o ciclo do cuidado, da prevenção ao acompanhamento de doenças crônicas, apoiando decisões clínicas e a gestão de dados. Contudo, o uso autônomo dessas ferramentas por leigos levanta dúvidas sobre segurança e impacto real na tomada de decisões em saúde.

Leia Mais

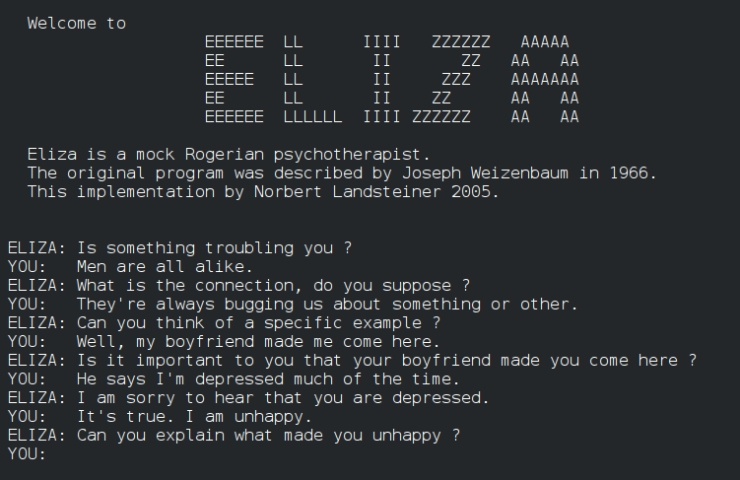

Além dos chatbots

Existem diferentes tipos e usos possíveis de sistemas de IA. Na medicina, eles abrangem desde ferramentas conversacionais voltadas ao público — como GPT Health, Gemini (MedGem), do Google, e algoritmos treinados para tarefas específicas — como análise de imagens, apoio ao diagnóstico e predição de risco em hospitais.

Modelos de linguagem (também conhecidos pela sigla em inglês LLM, que significa large language models), como os do GPT, geram respostas a partir de texto e dependem da qualidade da interação com o usuário. Já ferramentas de visão computacional e modelos clínicos são desenvolvidos para operar em contextos mais controlados, com dados estruturados e supervisão profissional.

Um dos principais avanços práticos está na organização e tradução da informação médica. De acordo com um estudo publicado em maio de 2025 no Communications Medicine, o uso do modelo GPT-4o para simplificar 60 resumos de alta hospitalar cardiológicos aumentou significativamente a clareza e a compreensão do conteúdo para os pacientes. A avaliação realizada por 12 especialistas médicos confirmou que essas versões simplificadas mantiveram altos índices de correção (85%) e integridade clínica, sem comprometer a segurança da informação.

Há também avanço no apoio ao diagnóstico e à tomada de decisão clínica. Uma metanálise de 50 estudos, publicada em janeiro no npj Digital Medicine, demonstrou que profissionais de saúde apoiados por modelos de linguagem superam o desempenho daqueles que trabalham de forma isolada, alcançando maior precisão diagnóstica. O estudo ressalta que essas ferramentas são mais eficazes como instrumentos de aumento cognitivo e apoio técnico, visto que esses modelos ainda não estão prontos para realizar diagnósticos de maneira independente.

“O mundo contemporâneo é fortemente alavancado por soluções de inteligência artificial. Na saúde não é diferente”, observa Edson. “O principal risco é o profissional não saber o que está fazendo. As pessoas que usam IA têm que estar treinadas para entender suas deficiências, porque esta ferramenta não é 100% precisa.” Ele defende que existam mecanismos “de contingência e contenção”.

“Contingência é um planejamento de como agir quando acontecer algo e, assim, você já sabe de antemão o que fazer. E contenção é um processo para, antes de algo acontecer, você já estar preparado e evitar consequências inadequadas”, explica.

Para o especialista, os resultados mais consistentes até agora ocorreram em áreas que lidam com dados não estruturados, como imagem, áudio e vídeo. Radiologia, patologia, dermatologia e oftalmologia estão entre as especialidades que mais se beneficiaram, em parte porque a análise automatizada desses dados já vem sendo explorada há décadas. Nesses casos, a IA contribui para detectar padrões, priorizar exames e reduzir variabilidade, sem substituir a decisão final do médico.

IA não é médico

Mas a expansão do uso de IA na saúde não significa que todas as aplicações tenham o mesmo nível de segurança. No caso de ferramentas conversacionais voltadas ao público, a exemplo do GPT Health, o desafio está na forma como a informação é produzida e apropriada por quem não tem formação médica.

Isso porque modelos de linguagem são sistemas de propósito geral, treinados para responder sobre diferentes temas, e não ferramentas especializadas. “Esses modelos são treinados para escrever coisas que façam sentido do ponto de vista de linguagem, não necessariamente corretos do ponto de vista técnico”, pondera Telma Soares, diretora-executiva do Centro de Excelência em Inteligência Artificial da Universidade Federal de Goiás (UFG).

“Dependendo, podem ser até alarmistas. Se você estiver em tratamento, fazendo uma série de exames, e colocar só o último [exame], não necessariamente a IA vai dar um resultado mais exato. Ela deveria ser usada como apoio para a pessoa entender melhor aquele assunto.”

Um estudo recém-publicado na Nature Medicine testou 10 cenários médicos com 1.298 participantes e concluiu que, na prática, o uso de modelos de IA para autoavaliação em saúde enfrenta limitações relevantes. Segundo a pesquisa, quando avaliados isoladamente, os modelos identificaram corretamente as condições clínicas em 94,9% dos casos. Na interação com usuários, porém, o desempenho caiu: em cenários de uso combinado com humanos, as IAs reconheceram menos de 34,5% das condições de saúde relevantes.

Os autores apontam que o principal problema está na troca incompleta de informações e na dificuldade dos modelos em comunicar respostas corretas de forma compreensível. “A IA nunca vai eliminar a busca por um profissional médico, mas pode ajudar o paciente a chegar com as perguntas certas e até a procurar o especialista adequado”, pondera Telma.

No dia a dia, esses limites aparecem menos como erros explícitos e mais como mudanças na dinâmica da consulta. Em vez de sintomas e dúvidas, pacientes chegam com hipóteses prontas e pedidos objetivos por exames — agora não só a partir de buscas no Google, mas também de respostas geradas por IA.

“Hoje em dia, a gente não vê mais pacientes com queixas inespecíficas, sem direcionamento. Eles já chegam com ideias fixas de coisas que acham que têm, de exames que acreditam ser necessários naquela ocasião”, relata a médica de família e comunidade Luisa Portugal Marques, do Einstein Hospital Israelita.

Esse padrão antecede a popularização das IAs. Em 2003, um estudo do Journal of Medical Internet Research já havia mostrado que pacientes recorrem à internet para interpretar sintomas e reduzir incertezas, revelando que 69% daqueles que fazem perguntas online buscavam, na verdade, um aconselhamento personalizado para sua situação.

Poucos anos depois, um estudo publicado no The Journal of the American Board of Family Medicine identificou que 79% dos pacientes pesquisavam doenças ou condições específicas na internet. O trabalho também mostrou impacto direto na consulta: 54% dos usuários discutiam as informações encontradas com seus médicos para verificar se estavam corretas, o que frequentemente exigia mais tempo de atendimento para contextualizar o que o paciente havia lido e corrigir interpretações equivocadas.

A diferença no cenário atual é que as IAs oferecem respostas contínuas, personalizadas e com aparência de autoridade, o que tende a intensificar esses efeitos. “Percebo os pacientes mais ansiosos e muitas vezes muito seguros daquilo, o que dificulta criarmos uma relação e fazermos as negociações dentro da consulta sobre o que pedir e o que não pedir de exame, por exemplo”, conta Luisa.

Para ela, o papel do médico é acolher. “Tudo bem as pessoas pesquisarem, porque isso dá a elas acesso a informações sobre saúde, o que ajuda de certa forma na autonomia e na autorresponsabilidade”, analisa a médica de família e comunidade.

Novos riscos

Embora ansiedade, autodiagnóstico e pressão sobre a consulta médica sejam fenômenos conhecidos desde a popularização da internet, estudos recentes sugerem que as IAs — especialmente as de modelos de linguagem — introduzem novos mecanismos de risco ligados à forma como a informação é produzida, apresentada e analisada.

Um deles é a tendência de validar premissas equivocadas, fenômeno conhecido como sycophancy, no qual os modelos priorizam concordar com o usuário em vez de aplicar raciocínio crítico. Um estudo publicado em 2025 mostrou que, quando uma afirmação clinicamente falsa é apresentada na própria pergunta, os modelos frequentemente a aceitam como válida e constroem a resposta a partir dela, em vez de corrigi-la. Em saúde, esse comportamento pode reforçar erros e transformar suposições em aparentes “verdades médicas”, sobretudo quando formuladas com linguagem segura e técnica.

Esse efeito se intensifica quando a desinformação aparece como registro clínico. Um artigo divulgado na Lancet Digital Health conclui que modelos de linguagem têm maior probabilidade de aceitar e reproduzir informações falsas quando elas são apresentadas com tom médico, semelhante ao de prontuários, laudos ou notas de alta. O achado é relevante para ferramentas voltadas à explicação de exames, resumos pós-alta e orientação domiciliar, nas quais a aparência de precisão técnica pode induzir confiança excessiva.

Há ainda evidências de vieses estruturais. Uma análise publicada em 2024 na Mayo Clinic Proceedings: Digital Health identificou que LLMs apresentam vieses em decisões simuladas de saúde, favorecendo determinados perfis de pacientes de acordo com raça, gênero, idade e outras características. Os autores alertam que, sem mecanismos explícitos de mitigação, o uso dessas tecnologias pode amplificar desigualdades já existentes.

Riscos específicos também aparecem em saúde mental, sobretudo quando a IA é usada como interlocutora. Uma análise de prontuários feita na Dinamarca e publicada em preprint em 2025 identificou casos em que o uso de chatbots esteve associado ao agravamento de delírios, ideação suicida e outros sintomas psiquiátricos. Um estudo de caso do mesmo ano, conduzido por médicos da Universidade da Califórnia em Los Angeles (UCLA), descreveu episódios de psicose de início recente em usuários sem histórico prévio, nos quais a interação prolongada com a IA e o fenômeno de bajulação do sistema funcionaram como elementos de reforço de crenças delirantes.

No Brasil, esse tipo de uso tende a crescer. Um relatório da consultoria Talk Inc., publicado em 2025, indicou que 13% dos brasileiros já utilizam essas ferramentas como “amigo ou conselheiro” para trocar e resolver questões pessoais e emocionais.

Gargalo da governança

A incorporação da IA à saúde esbarra em desafios que vão além do desempenho técnico. Uma das principais dificuldades é transpor resultados experimentais para o uso real, sobretudo quando ferramentas validadas em ambientes controlados passam a ser usadas em larga escala por profissionais ou diretamente pelo público.

Outro obstáculo é a fragmentação regulatória. Embora o CFM tenha publicado resolução específica para o uso da IA na prática médica no país, ainda não há diretrizes abrangentes, como leis, para o uso dessas ferramentas fora do contexto clínico supervisionado. Esses riscos se tornam ainda mais relevantes em contextos de maior vulnerabilidade social.

Em países como o Brasil, onde parte significativa da população tem menor escolaridade e acesso limitado a serviços de saúde, essas ferramentas podem reforçar a percepção de que a consulta médica é dispensável.

Além disso, podem ser instrumentalizadas para amplificar desinformação, servindo como fonte de argumentos para discursos negacionistas sobre vacinas e tratamentos. “Tem um lado positivo que pode ajudar tanto os profissionais quanto as pessoas que realmente só estão em busca de mais informação sobre saúde, mas também precisamos de ações para cuidar da outra parte da população que não está tão preparada para isso”, conclui Telma Soares, da UFG. A discussão sobre um marco legal para o uso da inteligência artificial em saúde está em andamento no Congresso.

Siga nosso canal no WhatsApp e receba notícias relevantes para o seu dia

Para Edson Amaro, a ausência de regras claras sobre quais soluções podem ser adotadas como boas práticas dificulta decisões de investimento e implementação, já que desenvolvedores e instituições não sabem se determinadas tecnologias poderão ser utilizadas. Ele avalia que iniciativas como a recente resolução do CFM representam um avanço ao estabelecer parâmetros para o uso da IA na prática médica. “Existem vários caminhos para que a gente atinja o máximo potencial do uso de IA de maneira responsável, mas isso ainda requer uma conversa maior da sociedade”, afirma.